可移植性和獨立機製原則

在臨床風險預測模型中可能有用的一個因果概念是獨立機製原理[1]。這一基本假設被形式化,以證明從觀測數據推斷因果結構的合理性[1,6],後來被認為是推動基於機器學習的預測方法的有用假設[7]。

這一獨立機製原則指出,“係統變量的因果生成過程由互不相互通知或影響的自主模塊組成”[1]。這意味著因果過程可以被解釋為一係列獨立的機製,其中每個因果機製將前一個機製的狀態輸出作為輸入,並將其自己的狀態輸出“饋送”給下一個機製。鏈上的每個因果機製都可以被概念化為對其接收的輸入不變的物理機製[1]。機製自治的概念實際上比看起來更直觀。事實上,這就是我們如何證明所有臨床幹預的合理性:我們假設人為地改變一種機製或其輸入不會影響任何其他機製[1]。

讓我們考慮兩個具有明確因果關係的變量。為簡單起見,我們稱這兩個變量為“Cause”和“Effect”。這兩個變量的聯合概率分布ℙ(原因,結果)可以用兩種方式分解[1,7]:

$$ \ mathm {\mathbb{P}}\左(\ mathm{原因},\ mathm{效果}\右)=\ mathm {\mathbb{P}}\左(\ mathm{效果}|\ mathm{原因}\右)\ mathm {\mathbb{P}}\左(\ mathm{原因}\右)=\ mathm {\mathbb{P}}\左(\ mathm{原因}|\ mathm{效果}\右)\ mathm {\mathbb{P}}\左(\ mathm{效果}\右)\ mathm {\mathbb{P}}\左(\ mathm{效果}\右)$$

獨立機製原理表明,變量Cause的邊際分布,ℙ(Cause),以及變量Effect對變量Cause的條件分布,ℙ(效果|原因),不包含彼此的信息[1,7]。的確,ℙ(Effect|Cause)是變量Effect對於變量Cause的每個給定值的分布。它表示將輸入(Cause)轉化為輸出(Effect)的物理機製,而ℙ(Cause)表示輸入的狀態。在獨立機製原則下,ℙ(原因),ℙ(Effect|Cause)在不同的聯合分布中相互獨立地變化[1]。

第一個分解中的獨立性約束在因果的條件分布,ℙ(Cause b| Effect),以及Effect的邊際分布,ℙ(效應),在反因果方向的第二次數學分解中顯示[1,7]。因此,ℙ(效果),ℙ(Cause b| Effect)在不同的關節分布中經常以依賴的方式變化[1]。由於這種獨立性概念涉及的是機製而不是變量,因此它不能像概率論中的統計獨立性概念那樣簡單地定義、檢驗或量化[1]。

在這項工作中,我們提出了兩個假設的,簡化的臨床例子,從神經退行性疾病的領域來說明後果獨立機製原理在診斷性臨床風險預測模型的背景下。具體來說,我們描述了兩種臨床風險預測模型的可移植性,用於使用不同的預測因子進行阿爾茨海默病的診斷。在第一個例子中,疾病是預測因子的影響(等位基因APOE ε4狀態,這是已知的阿爾茨海默病的原因),而在第二個例子中,疾病是預測因子的原因(腦脊液中tau蛋白的濃度,這被描述為阿爾茨海默病的病理過程的影響)。

預測器選擇和馬爾可夫毯

在建立臨床風險預測模型的第一步和可以說是最重要的一步中,還有另一個因果概念可能是有用的:預測者選擇。在這裏,我們關注的主要挑戰是選擇所有可用變量的最小可能子集,這些變量提供足夠的信息,以在校準方麵具有良好的有效性來預測感興趣的結果。

有許多眾所周知的原因來限製用於構建風險預測模型的預測因子的數量:(i)減少由於模型中大量變量導致的問題,從而提高性能;(ii)減少與數據收集和存儲、模型開發或培訓相關的成本、時間和精力;(iii)使模型更容易在不同環境中使用;以及(iv)增加生成概率估計背後機製的可解釋性[8,9]。最後一個原因在臨床風險預測模型中尤為重要。事實上,醫生不願意使用沒有一定程度可解釋性的預測模型[10],因為輸出概率用於支持有關治療和預防策略的臨床決策。

直觀地說,預測器選擇問題可以解釋為如何選擇最小的變量子集,排除所有不提供有關感興趣結果的附加信息的變量。

通過使用條件獨立的概念對缺乏附加信息進行操作[11],預測者選擇的整個問題類似於確定結果變量的所謂“馬爾可夫毯”。

我們將Y定義為興趣和結果的隨機變量X作為y的所有可用候選預測變量的集合X是與Y所涉及的因果過程相關的變量的超集。Y的馬爾可夫毯,MB(Y),是X,以此為條件,所有其他變量X不包含在MB(Y)中的數據與Y無關[8,9]:

V $ $ \原則\ mathrm{} \中\ mathbf {X} - \ mathrm {MB} \離開(\ mathrm {Y} \右):\公關\離開(\ mathrm {Y} | \ mathrm {MB} \離開(\ mathrm {Y} \右),\ mathrm {V} \右)= \公關\離開(\ mathrm {Y} | \ mathrm {MB} \離開(\ mathrm {Y} \) \右),$ $

在哪裏X -MB(Y)表示包含的變量集合X但單位不是MB(Y)。馬爾可夫毯的概念最初是由Pearl於1988年在他對貝葉斯網絡的研究中提出的[12]。多年後,它首次被用於確定預測任務的理論最優變量集[11]。

根據上麵的定義,給定MB(Y),則包含的其他變量X獨立於結果Y。這意味著它們不提供任何關於Y的進一步信息,所有預測結果行為的信息都已經包含在馬爾可夫包層MB(Y)中[1,13]。

如果用於構建Y預測模型的技術可以完全描述潛在的真實概率Pr(Y b| MB(Y)),並且首選變量較少的模型,則結果Y的馬爾可夫毯中包含的變量是唯一需要的變量在校準方麵進行最優預測[8]。因此,在理想回歸設置中,為了擬合合適的模型,預測器選擇任務包括找到結果變量的馬爾可夫毯[1,9]。這一概念可用於將臨床風險預測建模中的變量選擇與數據的潛在因果結構聯係起來[14]。

讓我們考慮DAGG以及由聯合分布描述的一組變量Sℙ年代有密度。分布ℙ年代,是關於的馬爾可夫函數G如果每個變量條件獨立於它的非子代(即不受它影響的變量),則給定它的父代(即它的直接原因)[1,9]。這個馬爾可夫性質在ℙ年代和G,確保DAG所需的所有條件獨立性也存在於概率分布中[1,15]。

另一個條件使這種聯係更加緊密;“忠實”意味著在聯合分布中唯一的條件獨立性ℙ年代那些人被卷入了嗎G[14]。

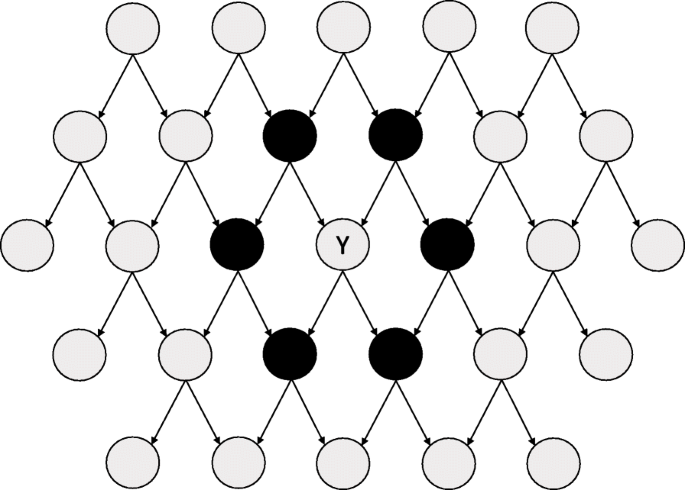

之前的直覺可以形式化;已經證明,如果變量的聯合分布相對於DAG是忠實的和馬爾可夫的,那麼預測器是強相關的(見[16,17[用於定義]用於預測結果,當且僅當它是結果的馬爾可夫毯的一部分[17]。在這些條件下,結果的馬爾可夫毯是唯一的,並且具有特定的構成:它包括結果節點的所有父節點,它的所有子節點,以及它的子節點的所有父節點[1,8,9,12]。

如圖所示。1,這些節點“保護”結果變量Y不受DAG中所有其他變量的影響[13]。因此,這些節點中包含的信息足以描述結果變量的狀態。

這些結果對負責選擇臨床風險預測模型預測因子的研究人員很有吸引力。根據2010年的一篇綜述,至少有8種不同的算法被開發出來,使用數據驅動的程序來識別結果變量的馬爾可夫毯子[9]。在因果學習領域,學習整個因果結構的算法[14]和局部因果結構[18基於馬爾可夫識別的毯子已經被開發出來。考慮到這一理論論證,我們相信了解數據生成背後的潛在因果過程可以幫助確定納入臨床風險預測模型的最佳預測因子。

作為概念驗證,我們使用R版本3.6.3進行了一係列模擬(R代碼可以在補充文件)。我們模擬了10萬個數據集,每個數據集有25個變量和1萬個觀察值。每個數據集都根據隨機生成的DAG進行模擬(使用dagitty R包中的randomDAG函數)。DAG包含25個有序節點,對應25個變量。給每個節點一個0.1的概率,從之前的每個節點接收到一個有向箭頭。然後隨機選擇其中一個節點作為感興趣的二進製結果,假設所有其他24個變量都是連續的。任何外生變量(即沒有任何父節點的變量)生成均值為0、方差為1的正態分布變量,或者如果結果是外生的,生成事件概率為0.2的伯努利隨機變量。

當結果為內生變量(即至少有一個父節點)時,每個觀測值都是從具有定義的概率參數的伯努利分布中提取的。這被設置為對結果節點的父變量的線性組合進行評估的逆logit函數,並隨機繪製係數。具體而言,結果內生變量的係數(包括截距)取自(- 1,1)上的均勻分布。

同樣,連續內生變量的觀測值隨機取自單位方差的正態分布,均值等於隨機抽取的係數與節點父變量值的線性組合。在這裏,每個內生變量的係數(包括截距)是從(- 2,2)上的均勻分布中繪製的。因此,回歸係數的選擇不受限製,以滿足設計的信度假設。

對於10萬個數據集中的每一個,開發了8個預測工具來預測二進製結果等於1的概率:

- (我)

一個邏輯回歸模型,隻包括結果的馬爾可夫毯中的變量作為預測因子;

- (2)

一個包含所有24個變量作為預測因子的邏輯回歸模型,

- (3)

一個邏輯回歸模型,包括任何具有通向結果節點的路徑的變量(無論路徑上的箭頭方向如何)作為預測因子;

- (iv)

邏輯回歸模型隻包括結果節點的父變量作為預測因子,

- (v)

一個輸入全部24個變量的logistic套索回歸模型,

- (vi)

一個輸入全部24個變量的logistic嶺回歸模型,

- (七)

一個混合參數alpha為0.5的logistic彈性網絡回歸模型,輸入全部24個變量,且

- (八)

隨機森林算法輸入所有24個變量。

在所有回歸模型中,所有納入的變量都被建模為與結果的logit線性相關。套索網、脊網和彈性網模型是使用glmnet R包中的glmnet函數計算的,具有默認設置。正則化參數,lambda,最小化了10倍的交叉驗證誤差,基於與cv的邏輯回歸的偏差。選擇Glmnet函數(Glmnet包)。隨機森林是使用隨機森林R包中的隨機森林函數構建的,其中有1000棵樹和默認設置。

對於每個數據集,每個預測工具的校準使用綜合校準指數[19] (ICI),基於10倍交叉驗證。ICI越低,模型校正效果越好。ICI估計依賴於結果變量和預測工具估計的預測風險之間的非參數回歸。因此,如果非參數回歸在10個交叉驗證集中的一個或多個中失敗,則不可能計算ICI。如果隻計算截距模型或變量回歸係數非常接近0的模型,就會發生這種情況。我們還比較了基於馬爾可夫毯子的邏輯模型中包含的變量集與套索和彈性網絡回歸模型所選擇的變量集。如果一個變量的估計回歸係數的絕對值是非零的,我們認為該變量是由模型選擇的,我們將其操作為大於10的值−10。